Искусственный интеллект в разработке помогает ускорить анализ требований, генерацию кода, тестирование и ревью, но мешает там, где нужны точность домена, контроль качества и безопасность. Надежное внедрение искусственного интеллекта в процесс разработки начинается с пилота, четких политик данных и интеграции в CI/CD, а не с массовой замены инструментов и ролей.

Краткая карта влияний ИИ на процесс разработки

- Ускоряет рутинные задачи: шаблонный код, миграции, рефакторинг, подготовку тестов и документации.

- Улучшает коммуникацию: резюме тикетов, уточняющие вопросы, конвертацию требований в acceptance criteria.

- Повышает риски: утечки кода/секретов, внедрение уязвимостей, галлюцинации, правовые ограничения.

- Сдвигает фокус инженеров: меньше ручного набора, больше постановки задач, проверки, архитектурных решений.

- Требует дисциплины: политика промптов, правила доступа, стандарты ревью и измерение эффекта.

Где ИИ ускоряет жизненный цикл продукта

Если вам нужен искусственный интеллект для разработки программного обеспечения с быстрым эффектом, начинайте с зон, где есть повторяемость и проверяемость результата. Лучше всего работает там, где входные данные структурированы (код, логи, требования) и есть автоматическая валидация (линтеры, тесты, статанализ).

Практические сценарии, где эффект обычно заметен

- Проработка требований: ИИ помогает уточнять двусмысленности, формировать чек-листы, варианты edge cases, черновики пользовательской документации.

- Декомпозиция задач: превращение цели в подзадачи, риски, зависимости, критерии готовности.

- Генерация кода с помощью искусственного интеллекта: скелеты модулей, адаптеры, сериализация, моки, примеры использования API.

- Рефакторинг и миграции: перевод между библиотеками/SDK, обновление устаревших конструкций, подсказки по улучшению читаемости.

- Тестирование: генерация тест-кейсов и каркасов unit/integration тестов, подсказки по параметризации.

- Саппорт и эксплуатация: суммаризация инцидентов, черновики postmortem, первичный разбор логов.

Кому подходит

- Командам с устойчивым процессом: есть код-стайл, тесты, ревью, CI и понятные границы ответственности.

- Продуктам с сильной автоматической проверкой: тестовое покрытие, статический анализ, правила безопасности.

- Организациям, готовым закрепить политики: что можно отправлять в модель, а что запрещено.

Когда не стоит начинать (или делать только локально)

- Если нет базовой гигиены: секреты в репозитории, нет ревью, CI нестабилен, тестов почти нет.

- Если домен высокорисковый (финансы/медицина/критическая инфраструктура) и нет процесса валидации и трассируемости решений.

- Если рассчитываете на "автопилот": ИИ не заменяет ответственность инженера за корректность и безопасность.

Точки, где ИИ создает помехи и как их нейтрализовать

ИИ чаще всего "ломает" процесс не из-за качества модели, а из-за отсутствия ограничений: что можно передавать в запросах, как хранить контекст, кто и как принимает итоговые изменения. Поэтому выбирайте ai инструменты для программистов с управлением доступами, журналированием и корпоративными политиками.

Типовые помехи

- Галлюцинации и неверные допущения: правдоподобный, но ошибочный код/объяснение/конфигурация.

- Скрытые уязвимости: небезопасные зависимости, инъекции, неправильная криптография, ошибочные настройки прав.

- Утечки: случайная отправка секретов, внутренних URL, фрагментов закрытого кода, персональных данных.

- "Быстрый, но чужой" код: стиль не совпадает с кодовой базой, ухудшается поддерживаемость.

- Смещение ответственности: "модель так сказала" вместо инженерной проверки и формального ревью.

Что понадобится до старта (требования, инструменты, доступы)

- Политика данных: что разрешено отправлять в модель; правила редактирования/маскирования секретов; перечень запрещенных категорий.

- Контроль доступа: SSO, роли, ограничения на плагины/интеграции, отдельные окружения для экспериментов.

- Журналирование: хотя бы на уровне "кто, когда, каким инструментом, к какому репозиторию применял подсказки" (без хранения чувствительного текста, если так безопаснее).

- Стандарты качества: обязательный запуск линтеров, тестов, SAST/Dependency scanning, правила code review.

- Безопасная интеграция: прокси/шлюз к моделям, allowlist доменов/репозиториев, запрет на отправку секретов.

Сводная таблица: роль → тип инструмента → ожидаемый эффект → основные риски

| Кому | Тип AI-решения | Где дает выигрыш | Риски и контроль |

|---|---|---|---|

| Backend/Frontend инженер | IDE-ассистент (автодополнение, чат по проекту) | Шаблонный код, рефакторинг, быстрые прототипы | Проверять тестами/ревью; запрет на вставку секретов; единый код-стайл |

| QA/Automation | Генерация тестов и тест-идей | Быстрее расширять набор проверок, искать edge cases | Не принимать тесты "как есть"; привязка к требованиям и данным; контроль флейки |

| DevOps/SRE | Ассистент для логов/инцидентов, генерация конфигов | Суммаризация, первичная диагностика, черновики runbook | Запрет на утечку ключей/токенов; ревью IaC; прогон через policy-as-code |

| Техлид/архитектор | Помощник для ADR, сравнения решений, ревью | Быстрее формировать альтернативы, вопросы к требованиям | Не подменять архитектурные решения; фиксировать допущения; ответственность у человека |

| Орг/безопасность | Корпоративные решения AI для разработки ПО (SSO, политики, аудит) | Масштабирование практики на команды, единые правила | Единая политика данных; аудит; контроль интеграций; обучение сотрудников |

Встраивание ИИ в CI/CD, тестирование и деплойment

Цель - встроить ИИ так, чтобы он ускорял подготовку изменений, но качество подтверждалось автоматикой и ревью. В CI/CD ИИ не должен "решать", он должен "предлагать", а решения фиксируются правилами пайплайна.

-

Определите два потока: подсказки и контроль

Подсказки живут в IDE/чатах и ускоряют работу. Контроль живет в CI: линтеры, тесты, SAST, проверка зависимостей и IaC-политики должны быть обязательными для каждого PR.

- Зафиксируйте: любой код, включая сгенерированный, проходит тот же процесс.

- Добавьте "Definition of Done": тесты/линт/безопасность зелёные.

-

Ограничьте доступы и контекст, который видит модель

Настройте SSO и минимальные права: репозитории, окружения, плагины. Для чатов по коду включайте только те базы знаний, которые допустимы по политике данных.

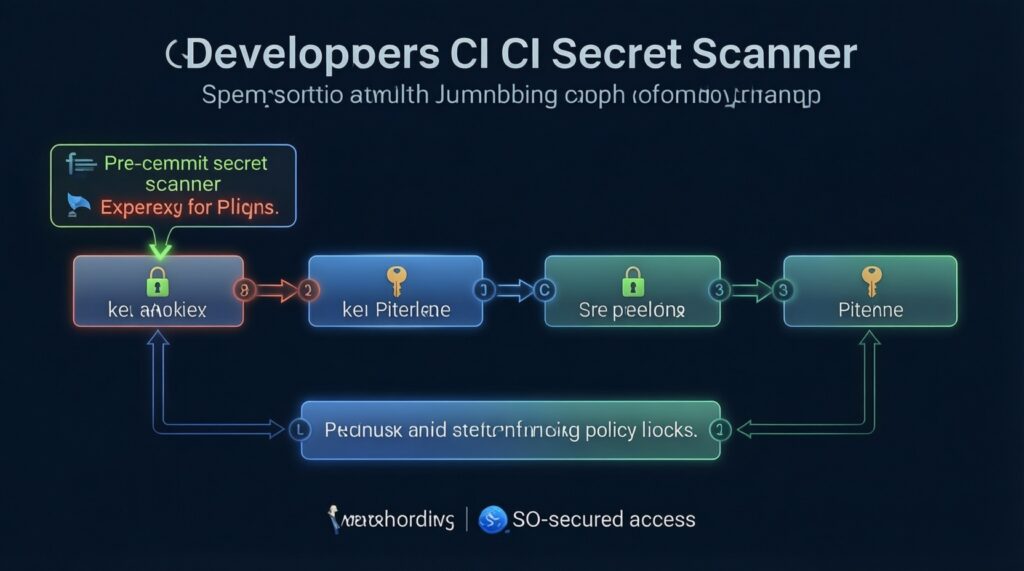

- Запретите отправку секретов и персональных данных; включите секрет-скан в pre-commit/CI.

- Разведите "песочницу" и "прод": разные ключи и политики.

-

Стандартизируйте промпты и шаблоны задач

Сделайте короткие шаблоны: "контекст → цель → ограничения → критерии приемки → формат ответа". Это снижает галлюцинации и делает результат воспроизводимым между разработчиками.

- Пример ограничения: "не добавляй новые зависимости без явного согласования".

- Пример формата: "дай diff/patch + список проверок".

-

Интегрируйте ИИ в ревью как второй взгляд, а не как судью

Используйте ассистента для предварительной проверки PR: потенциальные ошибки, сложные участки, несоответствие стилю, недостающие тесты. Финальное решение - за ревьюером по правилам команды.

- Требуйте от ИИ ссылки на конкретные файлы/фрагменты (или хотя бы точные места), иначе замечания не принимаются.

-

Закрепите автоматические "ворота" безопасности в CI

Чтобы ИИ не ускорял доставку уязвимостей, сделайте security checks блокирующими. Сгенерированный код не исключение и не "быстрый путь".

- SAST/linters, скан зависимостей, секрет-скан, проверки контейнеров/IaC.

- Политики деплоя: только из защищенной ветки, только после успешных проверок.

-

Добавьте "AI-метки" в процесс, чтобы видеть влияние

В PR/коммитах фиксируйте, где использовалась помощь ИИ (например, тэг в описании PR). Это поможет измерять эффект и разбирать инциденты без охоты на ведьм.

- Договоритесь о минимальном уровне маркировки: "использован ассистент для тестов/рефакторинга/доков".

Быстрый режим

- Начните с одного репозитория: IDE-ассистент + правила "всё через PR и CI".

- Запретите опасный контекст: секреты/ПДн/закрытые ключи; включите секрет-скан.

- Сделайте CI обязательным: линтер + тесты + скан зависимостей как блокирующие проверки.

- Введите шаблон промпта: цель, ограничения, формат diff и список проверок.

- Соберите обратную связь через 2-3 спринта: что ускорилось, что сломалось, что нужно закрепить политиками.

Изменения в ролях, навыках и процессе принятия решений

После внедрения ИИ часть работы "переезжает" из написания в проверку: важно формализовать, кто принимает решения и как подтверждается качество. Ниже чек-лист, по которому удобно проверять, что использование ИИ стало управляемым, а не хаотичным.

- Ревьюеры проверяют не только корректность, но и поддерживаемость: читаемость, стиль, отсутствие лишних абстракций.

- Разработчики умеют формулировать запросы: цель, контекст, ограничения, критерии готовности.

- Есть правило: любые изменения, включая автогенерацию, подтверждаются тестами и статанализом.

- Команда знает, как работать с ошибками модели: переформулировать задачу, требовать ссылки на код, просить альтернативы.

- Секреты и чувствительные данные защищены: pre-commit/CI сканирование, ротация, минимальные права.

- Определены "красные зоны": криптография, авторизация, биллинг, обработка ПДн - только с усиленным ревью.

- Есть владелец практики: кто обновляет правила, шаблоны промптов и обучающие материалы.

- Зафиксирован процесс инцидентов: как разбирать дефекты, если в изменениях участвовал ИИ (без обвинений, с улучшением контроля).

Пошаговый план: от пилота до промышленного использования

Чтобы внедрение искусственного интеллекта в процесс разработки не превратилось в "зоопарк инструментов", двигайтесь от узкого пилота к стандартизации. Ниже - ошибки, которые чаще всего ломают масштабирование, и что делать вместо этого.

- Ошибка: начинать со всех команд сразу. Делайте пилот на 1-2 командах и одном типе задач (например, тесты/рефакторинг).

- Ошибка: отсутствие политики данных. Зафиксируйте, что можно отправлять в модель, и внедрите технические ограничения.

- Ошибка: "AI-исключения" из правил качества. Не допускайте мерджа без CI и ревью, даже если код "сгенерирован".

- Ошибка: покупка инструмента без сценариев. Сначала определите 3-5 сценариев (use cases), затем под них выбирайте решения.

- Ошибка: нет владельца практики. Назначьте ответственного за шаблоны промптов, обучение и контроль внедрения.

- Ошибка: не учитывать лицензии и комплаенс. Проверьте требования юристов/ИБ к хранению данных, логам и интеграциям.

- Ошибка: игнорировать "красные зоны". Введите усиленное ревью и дополнительные проверки для auth/crypto/billing/PII.

- Ошибка: не учить людей проверять результат. Проводите короткие практики: как ловить галлюцинации, как требовать дифф и тест-план.

Как измерять эффект: метрики, контроль и обратная связь

Эффект от ИИ измеряйте не "скоростью генерации", а стабильностью доставки: сколько времени проходит от задачи до деплоя при сохранении качества. Если у вас уже есть DORA/метрики пайплайна - используйте их как базу, добавив маркеры использования ИИ.

Что фиксировать в процессе

- Сколько PR проходит с первого раза (без переработок после ревью/CI).

- Сколько дефектов/регрессий связано с изменениями, где использовался ИИ (по вашим меткам).

- Среднее время на ревью и доля замечаний по безопасности/качеству.

- Доля автогенерированных тестов, которые действительно ловят дефекты (а не просто "зелёные").

Альтернативные подходы и когда они уместны

- Локальные модели/on-prem: выбирайте, если нельзя отправлять код/контекст во внешние сервисы или нужен жесткий контроль данных.

- Шлюз к нескольким моделям: уместно, когда командам нужны разные модели под задачи, но вы хотите единые политики, аудит и ограничение контекста.

- Узкие "копайлоты" под один процесс: хорошо для предсказуемости (например, только генерация тестов или только суммаризация инцидентов).

- Без LLM, но с классической автоматизацией: иногда дешевле и надежнее закрыть задачу линтерами, шаблонами, генераторами кода и улучшением CI.

Типичные затруднения при внедрении и быстрые решения

Что делать, если ИИ предлагает код, который не проходит тесты или ломает стиль?

Запрашивайте ответ в формате diff и требуйте список команд для проверки. Закрепите линтер и тесты как блокирующие проверки в CI, чтобы "быстрый" код не проходил без валидации.

Как предотвратить ситуацию, когда команда случайно отправляет в модель секреты или внутренние данные?

Включите секрет-скан на pre-commit и в CI и запретите отправку конфигов/ключей правилами. Для корпоративного использования выбирайте инструменты с SSO и политиками данных.

Как ускорить ревью, если оно стало дольше из-за большого объема сгенерированного кода?

Ограничьте размер "порций": просите ИИ генерировать небольшие изменения и сопровождать их тестами. Добавьте правило: крупные рефакторинги дробятся на несколько PR.

Как снижать риск, если ИИ уверенно ошибается в доменной логике?

Всегда просите перечислить допущения и граничные случаи. Критические доменные участки (платежи, права, ПДн) проводите через усиленное ревью и дополнительные тесты.

Как понять, дает ли ИИ пользу, или это просто модный инструмент?

Помечайте PR, где использовался ассистент, и сравнивайте время цикла и качество до/после на одном и том же типе задач. Прекращайте сценарии, где растет число откатов и дефектов.

Как выбрать подходящие ai инструменты для программистов под вашу организацию?

Начните с требований: политика данных, аудит, интеграции с IDE и репозиториями, поддержка CI-процессов. Для больших организаций обычно лучше корпоративные решения ai для разработки ПО с централизованным управлением доступами.

Как избежать копипасты и разрастания зависимостей, когда идет генерация кода с помощью искусственного интеллекта?

Запретите добавление новых зависимостей без явного согласования и фиксируйте архитектурные решения в ADR. Периодически запускайте "чистку": удаление неиспользуемого кода и зависимостей, введенных в ходе экспериментов.