Системы логирования и мониторинга устроены как конвейер: сбор телеметрии (метрики/логи/трейсы) → нормализация → хранение с политиками удержания → визуализация и алерты. Если сразу договориться о формате событий, кардинальности меток, TTL и маршрутизации инцидентов, вы избежите шума, дорогого хранения и слепых зон при расследованиях.

Короткий чек-лист первичных настроек

- Срочно: определите, какие сервисы критичны, и заведите единый идентификатор запроса (trace/request_id) в логах.

- Срочно: включите базовые метрики хоста/контейнера и аптайм-чеки ключевых эндпоинтов.

- Важно: установите правила нормализации логов (JSON/ключи), фильтрацию секретов и лимиты объёма.

- Важно: задайте политики хранения: TTL по типам данных и ограничения кардинальности меток.

- Опционально: подготовьте SLO и маршрутизацию алертов по дежурствам (on-call) до первого прод-инцидента.

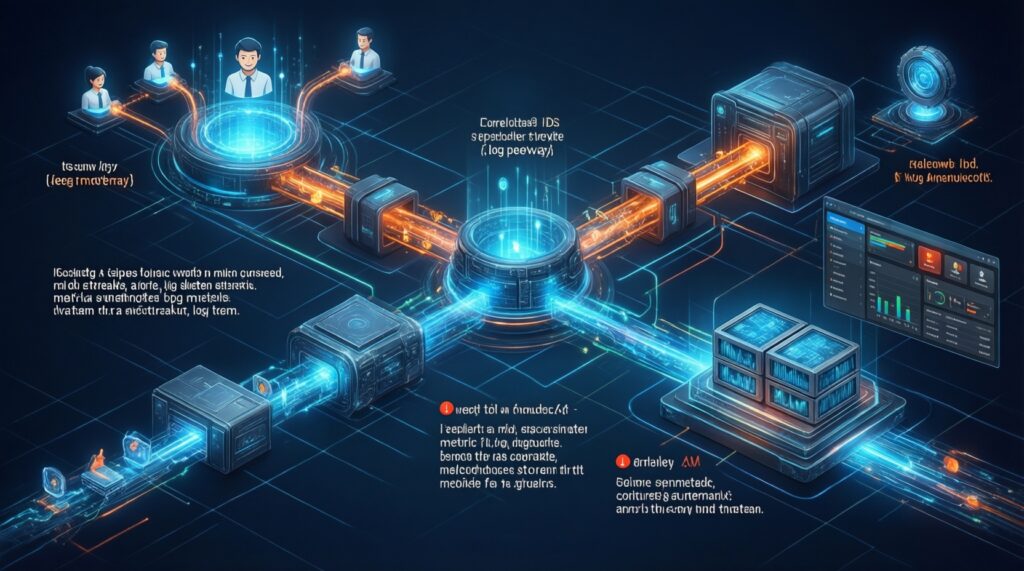

Архитектура систем логирования и мониторинга: компоненты и топологии

- Срочно: выберите поток данных: агент → шлюз/коллектор → хранилище → UI/алертер.

- Важно: разделите контуры метрик и логов (разные SLA/объёмы/TTL), но согласуйте идентификаторы корреляции.

- Важно: определите границы ответственности: платформа/инфра/продуктовые команды.

- Опционально: добавьте буферизацию (очередь/шиппер) для логов при сетевых сбоях.

Компоненты: сборщики (агенты/экспортеры), коллектор (приём/обогащение), хранилища (TSDB для метрик, индекс/объектное для логов), алертинг, дашборды, управление доступами.

Кому подходит: если нужно настроить мониторинг серверов и приложений так, чтобы по сигналу падает latency за минуты находить причину в логах/событиях. Когда не стоит усложнять: для одного VM/одного приложения без требований к SLA - начните с минимального набора метрик и логов, без распределённых топологий.

Практический минимум топологии: агент на узле + центральный коллектор + отдельные хранилища + единый UI. Не смешивайте сырой ingestion и пользовательский доступ в одной роли без строгих лимитов.

Сбор данных: агенты, протоколы и стандарты форматов

- Срочно: инвентаризируйте источники: ОС, контейнеры, reverse-proxy, БД, очередь, приложение.

- Важно: утвердите протоколы и форматы: метрики (Prometheus/OpenMetrics), логи (JSON), трейсы (OTLP).

- Важно: подготовьте доступы: права на чтение лог-файлов/журналов, открытые порты, service accounts.

- Опционально: добавьте обогащение: env, cluster, service, version, region (без лишней кардинальности).

Что понадобится:

- Доступ на хосты/в кластеры (SSH/SSM/Kubernetes RBAC) и возможность развернуть агент.

- Согласованный нейминг:

service,env,instance,version,trace_id/request_id. - Политика секретов: запрет на токены/пароли в логах, маскирование на коллекторе.

Пример (systemd): проверьте, что агент стартует и не теряет данные при рестарте.

sudo systemctl enable --now your-collector-agent

sudo systemctl status your-collector-agent

journalctl -u your-collector-agent -n 200 --no-pagerПример формата логов приложения (рекомендуемо JSON):

{

"ts":"2026-03-18T12:34:56.789Z",

"level":"INFO",

"service":"billing-api",

"env":"prod",

"msg":"payment confirmed",

"request_id":"9f3b2d...",

"trace_id":"1a2b3c...",

"user_id":12345

}Если вы на этапе выбора и пытаетесь система мониторинга купить или подобрать поставщика, требуйте в демо: единый pipeline для метрик/логов, контроль кардинальности, управление TTL и удобную корреляцию по trace_id.

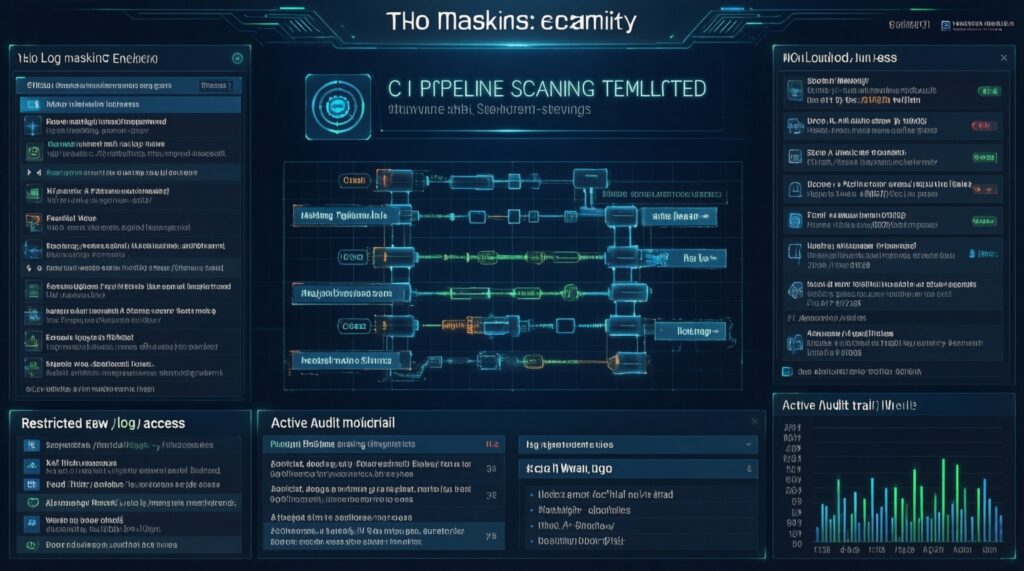

Парсинг и нормализация: правила, фильтры и схемы событий

- Срочно: определите золотые поля событий (ts, level, service, env, msg, trace_id/request_id).

- Важно: настройте маскирование и фильтры на коллекторе до записи в хранилище.

- Важно: сведите источники в общую схему и договоритесь о семантике уровней (ERROR/WARN/INFO).

- Опционально: добавьте обогащение контекстом (k8s labels, host metadata), но контролируйте объём.

Мини-чек-лист подготовки перед настройкой правил

- Срочно: выберите 3-5 критичных сервисов и по 2-3 типовых сценария (успех/ошибка/таймаут).

- Срочно: соберите по 50-100 строк логов каждого сценария (анонимизируйте персональные данные).

- Важно: выпишите поля, которые нужны в поиске и алертах (код ответа, endpoint, db_error, latency_bucket).

- Важно: согласуйте, где истина: в приложении (структурный лог) или в коллекторе (парсинг текста).

- Опционально: заведите тестовый индекс/неймспейс для проверок, чтобы не засорять прод.

-

Опишите схему события и запретите свободный текст как источник истины

Зафиксируйте обязательные поля и их типы (строка/число/булево). Если приложение пока пишет текстовые логи, начните с шаблонов парсинга, но параллельно планируйте переход на структурные логи.

- Срочно:

ts,level,service,env,msg - Важно:

request_idилиtrace_id,http.method,http.status_code

- Срочно:

-

Сделайте парсинг на коллекторе детерминированным

Определите порядок: распознать формат → извлечь поля → привести типы → назначить уровень → отбросить мусор. Любое угадывание должно быть последним шагом и только для некритичных источников.

Пример (псевдоконфиг пайплайна):

pipeline: - parse_json: {field: message, drop_on_error: false} - rename: {from: "timestamp", to: "ts"} - cast: fields: http.status_code: int duration_ms: int - set_level: from: "level" map: { "ERR":"ERROR", "WARN":"WARN", "INFO":"INFO" } - drop_fields: ["password","token","authorization"] - redact: fields: ["email","phone"] pattern: "(.*)" -

Нормализуйте метки и ограничьте кардинальность

Запрещайте в метках/labels значения высокой кардинальности (user_id, session_id, full URL с параметрами). Для логов оставляйте это в полях для поиска, но не в индексных ключах без необходимости.

- Срочно: не используйте query string как label; выделяйте только route (например,

/orders/:id). - Важно: версию приложения храните как

version, но не дублируйте во всех полях.

- Срочно: не используйте query string как label; выделяйте только route (например,

-

Добавьте корреляцию: логи ↔ метрики ↔ трейсы

Встраивайте

trace_id/request_idв логи и прокидывайте его через входной шлюз и межсервисные вызовы. В дашбордах держите ссылки из метрики в лог по одинаковым полям.Пример проверки в рантайме:

# найдите лог ошибки и проверьте, что request_id/trace_id присутствует grep -R "ERROR" /var/log/yourapp | head -

Проверьте правила на тестовом наборе и включите безопасный режим

Сначала включайте парсинг с

drop_on_error: falseи меткойparser_error=true, чтобы видеть процент нераспознанных событий. После стабилизации переводите ошибки парсинга в отдельный поток/индекс.

Если вы рассматриваете программное обеспечение для мониторинга и логирования как единый стек, заранее проверьте: поддерживает ли оно нормализацию на ingestion, маскирование и единые идентификаторы корреляции без кастомной разработки.

Хранение и политика удержания: индексирование, компрессия, TTL

- Срочно: разделите хранение по типам: метрики, логи приложений, аудит/безопасность, трассировки.

- Важно: настройте TTL/retention и защиту от взрывного роста (лимиты, квоты, rate limit).

- Важно: определите, что индексируется, а что хранится как payload для поиска по необходимости.

- Опционально: включите компрессию и tiering (горячее/тёплое/холодное) по политике.

- Срочно: метрики и логи лежат в разных хранилищах/индексах (или хотя бы в разных неймспейсах) с разным TTL.

- Срочно: есть лимит на размер одного события и защита от лог-штормов (rate limit/бэкофф).

- Срочно: включено маскирование секретов до записи на диск (проверьте на тестовой строке).

- Важно: определён список индексируемых полей; high-cardinality поля не индексируются без строгого обоснования.

- Важно: настроены роли доступа: кто видит прод-логи, кто может создавать алерты, кто меняет retention.

- Важно: есть бэкап/снапшоты для критичных данных (аудит/безопасность) и проверка восстановления.

- Опционально: заведён отдельный поток/индекс для

parser_error=trueи системных логов агентов. - Опционально: настроено холодное хранение для редких расследований и юридически значимых событий.

Оповещения и SLO: пороги, шумоподавление и маршрутизация инцидентов

- Срочно: определите критичные пользовательские сигналы: доступность, latency, error rate, насыщение ресурсов.

- Важно: настройте маршрутизацию: команда/дежурный/канал, и правила эскалации.

- Важно: добавьте дедупликацию и подавление повторов (grouping, silences, maintenance windows).

- Опционально: сформулируйте SLO и переведите часть алертов на burn-rate/скорость выгорания бюджета ошибок.

- Срочно: алерт по CPU/памяти без симптомов сервиса - шум; начинайте с SLI (ошибки/latency/доступность).

- Срочно: отсутствие runbook в описании алерта приводит к долгому MTTR; добавьте 3 шага проверки и ссылку на дашборд.

- Важно: пороги на глаз без учёта сезонности; используйте относительные условия или разные пороги для day/night.

- Важно: нет группировки - один инцидент превращается в сотни сообщений; включите grouping по

service/env/alertname. - Важно: алерт нет данных не настроен; отличайте реальную тишину от проблем сбора (separate alert на pipeline).

- Опционально: одинаковая важность для всех алертов; введите уровни (P1/P2/P3) и разные каналы доставки.

- Опционально: алерты завязаны на высококардинальные метки (instance, pod) и постоянно флапают; алертите по сервису, детали оставляйте в аннотациях.

В проектах, где обсуждают внедрение мониторинга и логирования под ключ, зафиксируйте в требованиях: SLO/SLI, дедупликацию, правила тишины, и обязательные runbook-ссылки в каждом алерте - иначе система быстро станет источником спама.

Визуализация и расследование инцидентов: панели, метрики и пошаговые сценарии

- Срочно: соберите 3 базовых дашборда: сервис (RED/USE), инфраструктура, pipeline сбора (агенты/коллектор).

- Важно: добавьте drill-down: из алерта → дашборд → выбор времени → ссылка на логи по

service/trace_id. - Важно: стандартизируйте первый экран для on-call: ошибки, латентность, насыщение, деплой/версия.

- Опционально: заведите шаблоны расследований (runbooks) и короткие сценарии проверки.

Альтернативы и когда уместны:

- Единая платформа всё в одном. Подходит, если вы хотите быстрее стартовать и вам важно одно окно; проверяйте лимиты, стоимость хранения и контроль кардинальности, особенно если планируете система логирования купить как готовый продукт.

- Best-of-breed стек (метрики отдельно, логи отдельно, трассы отдельно). Уместно, когда нужны лучшие возможности по каждому типу данных; заранее продумайте корреляцию и SSO, иначе расследования станут фрагментированными.

- Managed/SaaS. Подходит при дефиците SRE-ресурсов и требованиях к быстрому запуску; заранее решите вопросы вывоза данных, маскирования и разграничения доступа.

- On-prem/air-gapped. Уместно при ограничениях по данным; закладывайте время на обновления, бэкапы и масштабирование ingestion.

Шаблон сценария расследования (для runbook): 1) подтвердить влияние (SLO/ошибки/latency) 2) сузить до сервиса и версии 3) перейти к логам по trace_id 4) проверить зависимости (БД/очередь) 5) зафиксировать причину и улучшение (новый алерт/поле/дашборд).

Типичные эксплуатационные проблемы и практические решения

Почему алерты сыпятся, но прод работает?

Уберите алерты по ресурсам без пользовательских симптомов, включите дедупликацию и grouping по сервису. Добавьте уровни критичности и тишину на окна обслуживания.

Что делать, если в логах нет trace_id/request_id и корреляция невозможна?

Прокиньте идентификатор через входной шлюз и межсервисные вызовы, добавьте его в обязательные поля логов. На коллекторе отклоняйте или помечайте события без ключевых полей для критичных сервисов.

Как остановить рост хранилища после релиза?

Проверьте кардинальность меток и появление новых полей/индексов, включите лимиты на ingestion и размер события. Отдельно отследите лог-шторм и включите rate limit на источнике или коллекторе.

Почему сборщик жив, но данных нет, и как это диагностировать?

Разведите алерт pipeline down (агент/коллектор/очередь) и алерт no data по целевым метрикам. Проверьте права доступа к логам, сеть/порты и ошибки парсинга в отдельном потоке.

Как ускорить поиск по логам и снизить стоимость?

Сократите список индексируемых полей, уберите высококардинальные ключи из индекса. Перенесите часть запросов на метрики/агрегации и используйте payload для деталей.

Как предотвратить попадание секретов или персональных данных в логи?

Включите маскирование на коллекторе и добавьте проверки в CI (сканирование шаблонов). Ограничьте доступ к сырым логам и заведите аудит действий в системе.